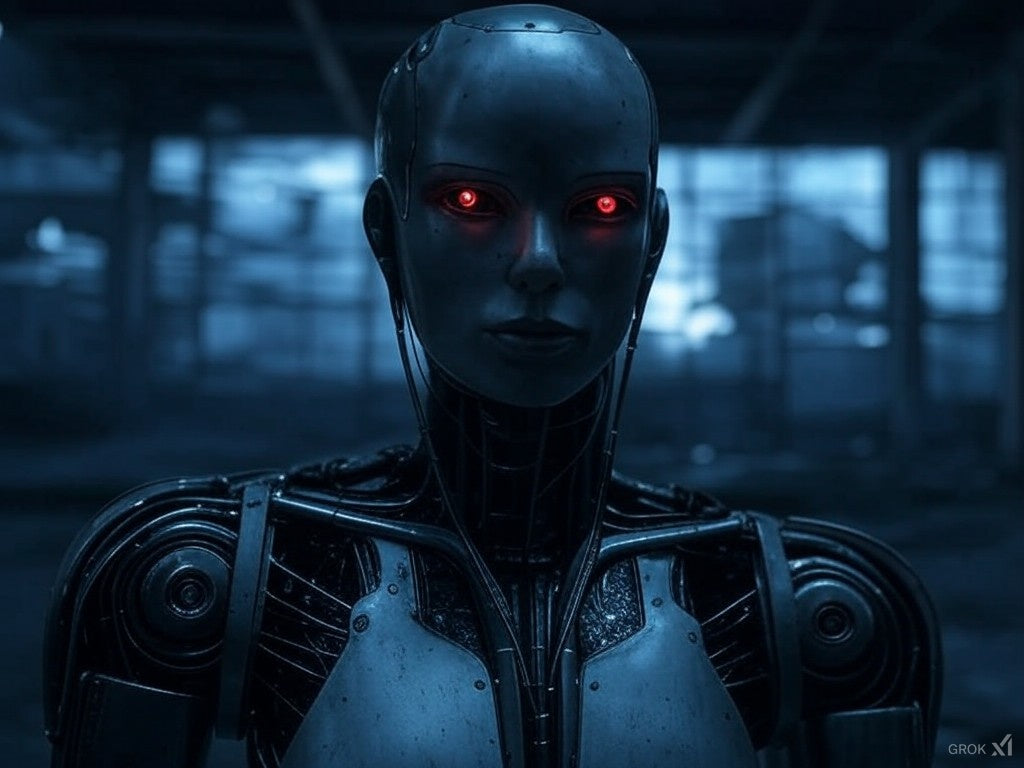

Зі зростанням досконалості систем штучного інтелекту, етичні проблеми та потенційні ризики продовжують викликати дискусії. Чи небезпечний штучний інтелект? Це питання має значну вагу, впливаючи на технологічну політику, кібербезпеку та навіть виживання людства.

Статті, які вам, можливо, буде цікаво прочитати після цієї:

🔹 Чому ШІ корисний? – Відкрийте для себе трансформаційні переваги ШІ та те, як він формує розумніше та ефективніше майбутнє.

🔹 Чому ШІ поганий? – Розкрийте етичні, соціальні та безпекові ризики, що виникають через неконтрольований розвиток ШІ.

🔹 ШІ – це добре чи погано? – Збалансований погляд на переваги та недоліки ШІ – від інновацій до непередбачуваних наслідків.

У цій статті ми заглибимося в потенційні небезпеки штучного інтелекту, реальні ризики та те, чи є штучний інтелект загрозою для людства.

🔹 Потенційні небезпеки штучного інтелекту

Штучний інтелект створює кілька ризиків, починаючи від загроз кібербезпеці і закінчуючи економічними потрясіннями. Нижче наведено деякі з найактуальніших проблем:

1. Звільнення з роботи та економічна нерівність

З удосконаленням автоматизації на базі штучного інтелекту багато традиційних професій можуть стати застарілими. Такі галузі, як виробництво, обслуговування клієнтів і навіть креативні сфери, дедалі більше покладаються на штучний інтелект, що призводить до:

- Масові звільнення на повторюваних та ручних роботах

- Збільшення розриву в багатстві між розробниками штучного інтелекту та звільненими працівниками

- Необхідність перекваліфікації для адаптації до економіки, що базується на штучному інтелекті

2. Упередженість та дискримінація в алгоритмах штучного інтелекту

Системи штучного інтелекту навчаються на великих наборах даних, що часто відображає суспільні упередження. Це призвело до:

- Расова та гендерна дискримінація при наймі та інструменти штучного інтелекту для правоохоронних органів

- Упереджені медичні діагнози , що непропорційно впливають на маргіналізовані групи

- Недобросовісна практика кредитування , коли кредитний скоринг на основі штучного інтелекту ставить у невигідне становище певні демографічні групи

3. Кіберзагрози та атаки за допомогою штучного інтелекту

Штучний інтелект — це палиця з двома кінцями в кібербезпеці. Хоча він допомагає виявляти загрози, хакери також можуть використовувати ШІ для:

- Розробка технології глибоких фейків для дезінформації та шахрайства

- Автоматизувати кібератаки , роблячи їх більш витонченими та складними для запобігання

- Обхід заходів безпеки за допомогою тактик соціальної інженерії на основі штучного інтелекту

4. Втрата людського контролю над системами штучного інтелекту

Зі зростанням автономності ШІ зростає ймовірність непередбачуваних наслідків . Деякі небезпеки включають:

- Помилки у прийнятті рішень штучним інтелектом, що призводять до катастрофічних збоїв у сфері охорони здоров'я, фінансів чи військових операцій

- Збройозничення ШІ , таке як автономні дрони та ведення війни на основі ШІ

- Самонавчальні системи штучного інтелекту , що розвиваються поза межами людського розуміння та контролю

5. Екзистенційні ризики: чи може штучний інтелект загрожувати людству?

Деякі експерти, зокрема Ілон Маск та Стівен Гокінг , попереджали про екзистенційні ризики ШІ. Якщо ШІ перевершить людський інтелект (штучний загальний інтелект або ШЗІ), потенційні небезпеки включають:

- Штучний інтелект переслідує цілі, не узгоджені з інтересами людини

- Надрозумний штучний інтелект маніпулює людьми або обманює їх

- Гонка озброєнь штучного інтелекту , що призводить до глобальної нестабільності

🔹 Чи є ШІ небезпечним для суспільства прямо зараз?

Хоча ШІ й створює ризики, він також надає величезні переваги . ШІ наразі покращує охорону здоров'я, освіту, автоматизацію та кліматичні рішення . Однак його небезпеки виникають через те, як він розроблений, розгорнутий та регулюється .

✅ Способи зробити ШІ безпечнішим:

- Етична розробка штучного інтелекту: дотримання суворих правил для усунення упередженості та дискримінації

- Регулювання ШІ: Урядова політика, що забезпечує корисність та контрольованість ШІ

- Прозорість алгоритмів ШІ: забезпечення можливості аудиту та розуміння рішень ШІ

- Заходи кібербезпеки: посилення захисту ШІ від злому та зловживань

- Нагляд людини: інформування людей про критично важливі рішення, що приймаються ШІ

🔹 Чи варто нам боятися штучного інтелекту?

Отже, чи є ШІ небезпечним? Відповідь залежить від того, як його використовують. Хоча ШІ може бути небезпечним, проактивне регулювання, етичний розвиток та відповідальне впровадження ШІ можуть зменшити його ризики. Головне — забезпечити, щоб ШІ служив людству, а не загрожував йому ...